نظام التعرف على الأوجه

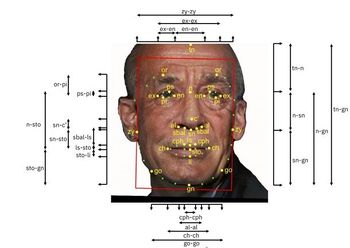

نظام التعرف الوجهي facial recognition system، هي تكتنولوجيا قادرة على تحديد أو التحقق من شخص عن طريق الصور الرقمية أو اللقطات المأهوذة من تسجيل الڤيديو. توجد عدة طرق لعمل نظم التعرف على الوجه، لكن بصفة عامة، تعمل هذه النظم عن طريق مقارنة سمات الوجه المختارة من الصورة المعنية ومقارنة الوجوه بالموجودة في قواعد البيانات. كما توصف تلك التقنية بأنها تطبيق يعتمد على الذكاء الاصطناعي القياسي الحيوي الذي يمكنه تحديد الأشخاص بشكل فريد من خلال تحليل الأنماط استناداً على سمات وشكل وجه الشخص. [1][مطلوب مصدر أفضل]

بينما كان في البداية أحد أشكال تطبيقات الحاسوب، فقد النظام شهدت استخدامات أوسع في الآونة الأخيرة على منصات متحركة وفي أشكال أخرى من التكنولوجيا، مثل الروبوتات. عادة ما يستخدم كنظام تحكم في الولوج في أجهزة الأمن ويمكن مقارنته بالمقاييس الحيوية الأخرى مثل أنظمة التعرف على بصمة الأصبع أو قرنية العين.[2] على الرغم من دقة نظام التعرف على الوجه كتقنية قياس حيوي إلا أنه يعتبر أقل دقة من نظام التعرف على القرنية وبصمة الأصبع، ويعتمد على نطاق واسع نظراً لعمله بشكل غير تلامسي وغير تداخلي.[3] مؤخراً، أصبح أيضاً أداة شائعة للتسويق والتحديد التجاري.[4] تتضمن التطبيقات الأخرى التفاعل المتقدم بين الإنسان والحاسوب، مراقبة الڤيديو، الفهرسة التلقائية للصور وقاعدة الڤيديو، وغيرها.[5]

تاريخ التقنية

تقنيات الحصول على سمات الوجوه

التقليدية

التعرف على الأبعاد

تحليل نسيج البشرة

الدمج مع تقنيات أخرى

الكاميرات الحرارية

التطبيق

المنصات المحمولة

وسائل التواصل الاجتماعي

في 15 فبراير 2022، رفع مكتب المدعي العام في تكساس دعوى قضائية ضد فيسبوك، زاعمًا أن عملاق وسائل التواصل الاجتماعي انتهك حماية خصوصية الدولة من خلال تقنية التعرف على الوجه التي جمعت البيانات البيومترية لملايين تكساس دون موافقتهم. وتتهم الدعوى شركة فيسبوك بالتقاط معلومات بيومترية من الصور ومقاطع الفيديو التي حملها المستخدمون دون موافقتهم، والكشف عن المعلومات للآخرين وعدم إتلافها في غضون فترة زمنية معقولة. [6]

وقال المدعي العام كين پاكستون في بيان "هذا مثال آخر على الممارسات التجارية الخادعة لإحدى عمالقة التكنولوجيا ويجب أن يتوقف. سأواصل الكفاح من أجل خصوصية تكساس وأمنها". وكانت صحيفة وول ستريت جورنال أول من أفادت بشأن الدعوى القضائية، والتي نقلت عن شخص مطلع على الأمر قوله إن الولاية كانت تسعى للحصول على مئات المليارات من الدولارات كعقوبات مدنية.

ولدى سؤاله عن الدعوى، قال متحدث باسم ميتا، مالكة فيسبوك: "هذه الادعاءات لا أساس لها وسندافع عن أنفسنا بقوة". وقالت الشركة في منشور على مدونة في نوفمبر 2021 إنها كانت تغلق نظام التعرف على الوجه وستحذف معلومات أكثر من مليار شخص. وأشار إلى مخاوف بشأن استخدام التكنولوجيا وعدم اليقين بشأن ماهية القواعد المتعلقة باستخدامها. كما وافقت على دفع 650 مليون دولار في عام 2020 لتسوية دعوى قضائية في ولاية إلينوي تعاملت مع مخاوف مماثلة.

تقول الدعوى الجديدة، التي رُفعت في محكمة ولاية في مارشال، تكساس، أن 20.5 مليون تكساس لديهم حساب على فيسبوك. وقالت الدعوى: "نطاق سوء سلوك فيسبوك مذهل". وقالت الدعوى: "استولى فيسبوك مرارًا وتكرارًا على المعرّفات البيومترية لتكسان دون موافقة ليس بالمئات أو الآلاف أو الملايين من المرات - بل مليارات المرات".

حلول التحقق من الهوية

الهوية الوجهية

نشره في الخدمات الأمنية

الشرطة

الأمن الوطني

في 18 فبراير 2019 كشف تقرير أعده ڤيكتور جيفرز، أحد مؤسسي منظمة جي دي آي الغير ربحية، إن شركة سنس نتس المحدودة للتكنولوجيا، شركة صينية متخصصة في تقنيات المراقبة، تتعقب تحركات وبيانات أكثر من 2.5 مليون شخص من أقلية الأويغور ذات الأغلبية المسلمة في إقليم شينجيانگ في أقصى غرب الصين.[7]

وقال جيفرز إن الشركة الصينية المختصة في تقنية التعرف على الوجوه، تركت دون حماية، لشهور، قاعدة بيانات على الإنترنت، تحتوي على أسماء وأرقام بطاقات تعريف الهوية، وتواريخ الميلاد، والموقع للأشخاص المراقبين. وكشفت تلك البيانات نحو 6.7 مليون موقع مرتبط بمن خضعوا للمراقبة جرى تجميعها خلال 24 ساعة، وعليها وصف مثل مسجد وفندق ومقهى للإنترنت وأماكن أخرى من المرجح أن يكون فيها كاميرات للمراقبة. ونقلت رويترز عن جيفرز قوله: "كانت البيانات متاحة بالكامل، ويمكن لأي شخص دون إذن دخول قاعدة البيانات وقراءة وتحديث ومحو أي شيء".

استخدامات إضافية

المميزات والعيوب

مقارنته بأنظمة القياس الحيوي الأخرى

جوانب الضعف

عدم الفعالية

عدم الدقة

في السنوات القليلة الماضية، ظهرت زيادة كبيرة في استخدام تكنولوجيا التعرف على الوجوه وكشفها وتحليلها. من المرجح أن أكثرها ألفة بالنسبة للعامة هي أنظمة التعرف على الوجوه، مثل نظام اقتراح الإشارات على الصور في فيسبوك، ونظام أپل آي دي الذي يستطيع التعرف على أشخاص محددين، أما أنظمة الكشف فهي تحدد وجود الوجه بشكل عام، وتقوم أنظمة التحليل بمحاولة تجديد بعض الصفات مثل الجنس والعرق، وتستخدم جميع هذه الأنظمة حالياً لأهداف مختلفة، بدءاً من التوظيف والبيع بالتجزئة وصولاً إلى الحماية والمراقبة.

يعتقد الكثيرون أن هذه الأنظمة دقيقة وحيادية للغاية، وذلك لأن أفراد أمن المطارات يمكن أن يصابوا بالتعب، ويمكن لأفراد الشرطة أن يخطئوا في تقييم المشتبه بهم، ولكن نظام الذكاء الاصطناعي حسن التدريب سيكون قادراً على تحديد هوية الوجوه وتصنيفها بشكل مستمر وبدون أخطاء.

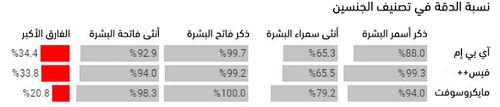

ولكن من الناحية العملية، أظهرت الأبحاث، وبشكل متكرر، أن هذه الأنظمة تتعامل مع بعض المجموعات الديموغرافية بشكل أقل دقة من غيرها. ففي 2018، وجدت دراسة باسم "ألوان الجنسين"، وهي دراسة مؤثرة أجرتها الباحثة جوي بولامويني من مختبر الميديا في إم آي تي أن أنظمة تصنيف الجنسين، التي تبيعها شركات آي بي إم ومايكروسوفت وفيس پلس پلس، تعاني من نسبة خطأ أعلى بمقدار 34.4% بالنسبة للإناث سمراوات البشرة بالمقارنة مع الذكور من ذوي البشرة الفاتحة، كما وجد الإتحاد الأمريكي للحريات المدنية في كاليفورنيا الشمالية، وبشكل مشابه، أن منصة أمازون كانت تخطيء في تحديد أعضاء الكونجرس من ذوي البشرة غير البيضاء أكثر من أقرانهم بيض البشرة.

تكمن المشكلة في أن أنظمة التعرف على الوجوه وأنظمة تحليل الوجوه غالباً ما تدرب باستخدام مجموعات بيانات مختلفة، حيث أن هذه المجموعات تحوي من صور النساء والأشخاص ذوي البشرة السمراء أقل بكثير من صور الرجال والأشخاص من ذوي البشرة البيضاء. وعلى الرغم من أن يفترض أن الكثير من هذه الأنظمة تخضع لاختبارات العدالة، فإن هذه الاختبارات لا تتحقق من الأداء على مجال واسع بما فيه الكفاية من الوجوه، كما وجدت بولامويني، وتترسخ هذه التباينات وتؤدي إلى تعزيز التمييز الموجود مسبقاً، وقد تؤدي إلى عواقب وخيمة عند وجود أمور هامة على المحك.[8]

تم نشر ثلاثة أبحاث جديدة مؤخراً، وهي تثير الانتباه المطلوب حول هذه المسألة:

- البحث الأول: نشرت بولاميني تحديثاً لألوان الجنسين بإعادة اختبار الانظمة التي تفحصتها من قبل، وتوسيع دراستها حتى تشمل نظام ريكوجنيشن من أمازون، ونظاماً جديداً من شركة صغيرة للذكاء الاصطناعي تسمى كيروس، وهناك بعض الأخبار الجيدة، فقد وجدت أن آي بي إم وفيس بلس بلس وميكروسوفت قامت جميعاً بتحسين دقة تحديد الجنس بالنسبة للنساء سمراوات البشرة، وقد خضفت مايكروسوفت نسبة الخطأ إلى أقل من 2%. من ناحية أخرى، ما زالت منصتا أمازون وكايروس تعانيان من فارق في الدقة بمقدار 31% و23% على الترتيب، ما بين الذكور ذوي البشرة الفاتحة والنساء السمراوات. وقالت بولامويني أن الدراسة تبين أن هذه التكنولوجيات يجب أن تخضع لتدقيق شديد قبل أن تعتبر موثوقة بما يكفي.

- البحث الثاني: نشرت دراسة من مختبر علوم الحاسب والذكاء الاصطناعي (CSAIL) في إم آي تي، وهي تبين فعالية خوارزمية جديدة للتخفيف من التحيز في نظام كشف الوجوه، حتى لو تم تدريبه باستخدام مجموعة شديدة التحيز. فأثناء عملية التدريب، تقوم الخوارزمية أيضاً بتحديد الأمثلة التي لم تأخذ نسبة كافية من البيانات، وتمضي وقتاً إضافياً في تفحصها للتعويض عن هذا النقص. وعندما اختبر الباحثون هذا النظام باستخدام مجموعة بيانات اختبار ألوان الجنسين لبولاميني، وجدوا أنه ساعد على التقليل إلى حد كبير من فرق الدقة ما بين الذكور ذوي البشرة الفاتحة والسمراء، مقارنة مع خوارزمية تدريب معتادة، على الرغم من أنه لم يقض على الفرق تماماً.

- البحث الثالث: نشر قسم الأبحاث في آي بي إم بحثاً يحدد العشرات من الميزات اللازمة لقياس التنوع، بحيث تتجاوز الميزات التقليدية مثل لون البشرة والجنس، وتتضمن ارتفاع الرأس، وعرض الوجه، والبعد ما بين العينين، والعمر. وقد بينت هذه النتائج على أبحاث سابقة حول الوجوه البشرية، يقول جون سميث، أحد مؤلفي البحث: "إذا لم يكن لدينا مقاييس واضحة للتنوع الوجهي، فليس من الممكن أن نعود ونفرضها على أنظمة التعرف على الوجوه". وقد أطلق الفريق مع البحث مجموعة بيانات جديدة تتضمن مليون صورة لوجوه مصنفة حسب هذه المقاييس الجديدة.

اتخذت كل من هذه الدراسات خطوات هامة نحو معالجة مسألة التحيز في التعرف على الوجوه، وذلك بتحميل المسؤولية للشركات، وبناء خوارزميات جديدة، وتوسيع فهمنا للتنوع في البيانات، ولكن بناء أنظمة أكثر عدالة ودقة ليس سوى نصف المعركة.

جدل

انتهاكات الخصوصية

يمكن استخدام جميع الأنظمة، بما فيها أكثرها عدالة ودقة، لانتهاك الحريات المدنية للناس. ففي 2018، كشف تحقيق لموقع ديلي بيست أن أمازن كانت تسعى إلى عرض منصتها الخاصة بمراقبة الوجوه على إدارة الهجرة والجمارك الأمريكية، المعروفة باسم آيس ICE، وذلك لمساعدتها على التعامل مع المهاجرين. وقد كشف تحقيق آخر أن آي بي إم قامت بتطوير القدرة على تحديد الانتماء العرقي من الوجوه في إطار شراكة طويلة مع شرطة مدينة نيويورك. وقد تم تزويد كاميرات المراقبة العامة بهذه التكنولوجيا في ذلك الحين بهدف اختبارها بدون معرفة مواطني المدينة. كما أن شرطة المدن في المملكة المتحدة تستخدم التعرف على الوجوه لمسح الحشود بحثاً عن الأشخاص الموجودين على قوائم المراقبة، وتستخدم الصين هذه التكنولوجيا للمراقبة الجماعية لجميع مواطنيها، لعدة أغراض تتضمن تتبع المعارضين.

استجابة للتزايد السريع لهذه الأنظمة، تزايدت النداءات من ناشطي الحقوق المدنية وأخصائيي التكنولوجيا لوضع قواعد ناظمة لعملها، بل إن گوگل علقت مبيعات أنظمة كهذه إلى حين وضع استراتيجيات واضحة لمنع إساءة استخدامها. تقول بولاميني من إم آي تي: "بدون تنظيم الخوارزميات بشكل قانوني، فإن الدقة والعدالة التكنولوجية في الخوارزميات ستؤدي إلى ظهور أدوات تعتمد على الذكاء الاصطناعي ويمكن استخدامها كأسلحة ضدنا".

تقنية ديپفيس على فيسبوك

التكنولوجيا المنقوصة في إنفاذ القانون

الكشف عن العواطف

الأنظمة المضادة للتعرف على الوجه

انظر أيضاً

- AI effect

- تطبيقات الذكاء الاصطناعي

- Automatic number plate recognition

- Biometric technology in access control

- Coke Zero Facial Profiler

- Computer processing of body language

- رؤية الحاسوب

- Eigenface

- التحقق من الوجه

- تحقيق شخصية وجهي

- Face perception

- FindFace

- اختبار گلاسگو لمطابقة الوجه

- التعرف على القرنية

- MALINTENT

- Artificial intelligence for video surveillance

- Multimedia information retrieval

- Multilinear subspace learning

- Pattern recognition, analogy and case-based reasoning

- Retinal scan

- Super recognisers

- Template matching

- التعرق على الوجه ثلاثي الأبعاد

- Vein matching

- Gait analysis

- قوائم

المصادر

- ^ "What is Facial Recognition? - Definition from Techopedia". Techopedia.com (in الإنجليزية). Retrieved 2018-08-27.

- ^ "Face Recognition Applications". Animetrics. Retrieved 2008-06-04.

- ^ Zhang, Jian, Yan, Ke, He, Zhen-Yu, and Xu, Yong (2014). "A Collaborative Linear Discriminative Representation Classification Method for Face Recognition. In 2014 International Conference on Artificial Intelligence and Software Engineering (AISE2014). Lancaster, PA: DEStech Publications, Inc. p.21 ISBN 9781605951508

- ^ "Facial Recognition: Who's Tracking You in Public?". Consumer Reports (in الإنجليزية الأمريكية). Retrieved 2016-04-05.

- ^ خطأ استشهاد: وسم

<ref>غير صحيح؛ لا نص تم توفيره للمراجع المسماة:8 - ^ "Texas sues Meta's Facebook over facial-recognition practices". رويترز. 2022-02-15. Retrieved 2022-02-15.

- ^ "تسريب يكشف مراقبة الصين لـ 2.5 مليون مسلم". سكاي نيوز عربية. 2019-02-18. Retrieved 2019-02-18.

- ^ "هل يعني الحد من تحيز التعرف على الوجوه أنه أصبح أقل إخافة؟". إم آي تي رڤو. 2019-02-10. Retrieved 2019-02-19.

Tucker,J (2014). How faicial recognition technology came to be, retrieved from https://www.bostonglobe.com/ideas/2014/11/23/facial-recognition-technology-goes-way-back/CkWaxzozvFcveQ7kvdLHGI/story.html

قراءات إضافية

- What are Biometrics? White Paper Published by Aware, Inc., January 2014

- Farokhi, Sajad; Shamsuddin, Siti Mariyam; Flusser, Jan; Sheikh, U.U; Khansari, Mohammad; Jafari-Khouzani, Kourosh (2014). "Near infrared face recognition by combining Zernike moments and undecimated discrete wavelet transform". Digital Signal Processing. 31 (1). doi:10.1016/j.dsp.2014.04.008.

- "The Face Detection Algorithm Set to Revolutionize Image Search" (Feb. 2015), MIT Technology Review

- Garvie, Clare; Bedoya, Alvaro; Frankle, Jonathan (18 October 2016). Perpetual Line Up: Unregulated Police Face Recognition in America. Center on Privacy & Technology at Georgetown Law. Retrieved 22 October 2016.

- "Facial Recognition Software 'Sounds Like Science Fiction,' but May Affect Half of Americans". As It Happens. Canadian Broadcasting Corporation. 20 October 2016. Retrieved 22 October 2016. Interview with Alvaro Bedoya, executive director of the Center on Privacy & Technology at Georgetown Law and co-author of Perpetual Line Up: Unregulated Police Face Recognition in America.

وصلات خارجية

Media related to Facial recognition system at Wikimedia Commons

Media related to Facial recognition system at Wikimedia Commons- A Photometric Stereo Approach to Face Recognition". University of the West of England. http://www1.uwe.ac.uk/et/mvl/projects/facerecognition.aspx

- CS1 الإنجليزية الأمريكية-language sources (en-us)

- Articles with hatnote templates targeting a nonexistent page

- Missing redirects

- كل المقالات بدون مراجع موثوقة

- كل المقالات بدون مراجع موثوقة from September 2018

- التعرف على الوجه

- Automatic identification and data capture

- مراقبة الڤيديو

- مراقبة

- Machine learning task